如何使用

随着近两年AI的发展,开源社区Github涌现出了许多优秀的开源AI程序项目,用户可以基于自身需要选择合适的开源AI程序进行使用,经实践发现,支持OpenAI Compatible(OpenAI兼容)的程序均可使用本站API,很庆幸大部分AI程序都在这样做。统一接入方式:Base_Url接口 + API Key。

API接口视程序情况而定,一般存在以下三种情况,其中绝大部分是第一种情况:

https://api.juheai.top

https://api.juheai.top/v1

https://api.juheai.top/v1/chat/completions下面我们将列出一部分优秀AI应用程序的配置方法,以帮助用户节约时间快速使用程序:

LibreChat

介绍: 国外的项目,仿GPT PLUS界面UI的ChatUI程序,迄今为止最为强大的ChatUI,程序最牛逼的地方在于支持丰富的AI功能,对话、RAG分析文件、插件、语音、多端同步样样都行。

项目地址: https://github.com/danny-avila/LibreChat

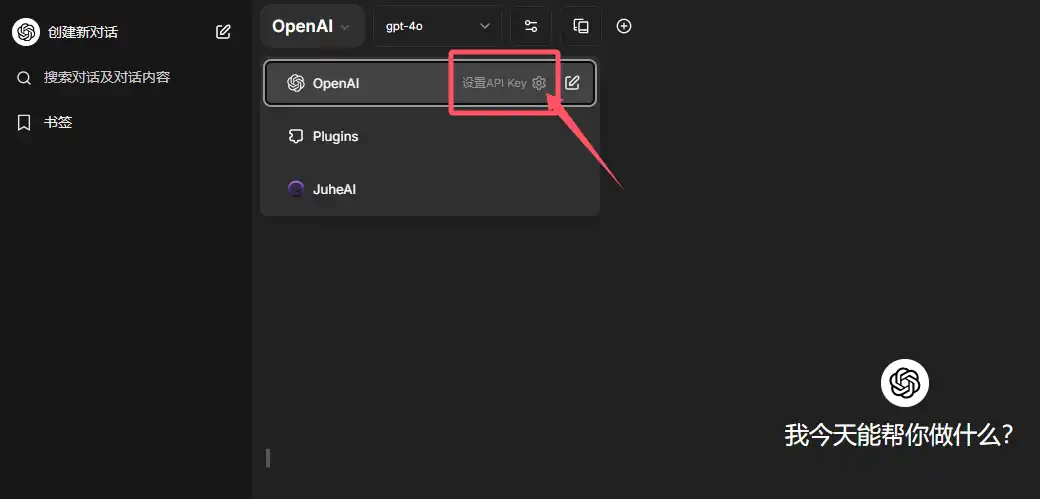

配置: 一般登录程序后仅需要填写API Key即可,访问入口: https://librechat.aijuhe.top/login 。如需自行部署,可以参考文章《Librechat快速部署指南》。

NextChat

介绍: 这是一个中国大佬的项目,因为做的太丝滑团队导致被收购了,目前新的团队也出了商业版本,不过失去了大佬的创作,商业版风格直接变了味,还是开源版比较舒服。

项目地址: https://github.com/ChatGPTNextWeb/ChatGPT-Next-Web

配置: 需要在设置中勾选自定义接口,并填写接口地址:https://api.juheai.top 和 API KEY,访问入口: https://nextchat.aijuhe.top 。如需自行部署,可参考文章《通过NextChat(ChatGPT-Next-Web)低成本给自己或客户部署GPT程序》

Dooy-AI

介绍: github原名叫chatgpt-web-midjourney-proxy,作者是Dooy,项目名字又长识别度又低,索性咱们以作者名字冠名更朗朗上口,这个项目除了支持chat外,还支持midjourney绘图、suno音乐、luma视频创作的可视化操作,可玩性极高。

项目地址: https://github.com/Dooy/chatgpt-web-midjourney-proxy

配置: 需要在设置中填写接口地址:https://api.juheai.top 和 API Key,访问入口:https://dooy.aijuhe.top 。如需自行部署,可参考文章《拥有私人GPT:chatgpt-web-midjourney-proxy完整部署指南》

![]()

LobeChat

介绍: 现代化设计的开源 ChatGPT/LLMs 聊天应用与开发框架,支持语音合成、多模态、可扩展的(function call)插件系统,一键免费拥有你自己的 ChatGPT/Gemini/Claude/Ollama 应用。

项目地址: https://github.com/lobehub/lobe-chat

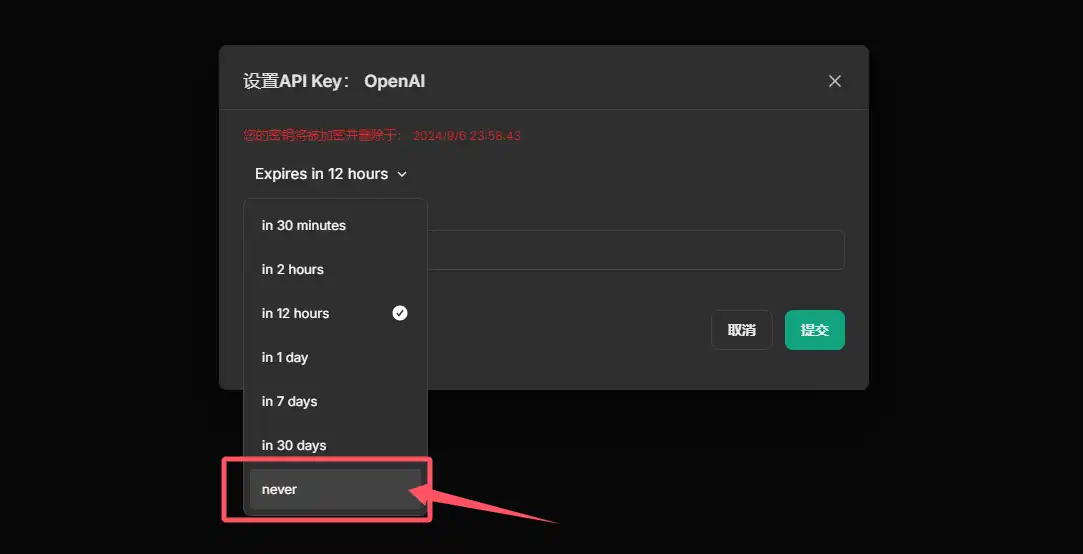

配置: 需要在设置中填写接口地址:https://api.juheai.top/v1 和API Key,访问入口:https://lobe.aijuhe.top/ 。

Chatbox

介绍: Chatbox AI 是一款 AI 客户端应用和智能助手,支持众多先进的 AI 模型和 API,可在 Windows、MacOS、Android、iOS、Linux 和网页版上使用。

项目地址: https://github.com/Bin-Huang/chatbox

配置JSON:

{

"id": "https://www.juhenext.com",

"name": "JuheNext",

"type": "openai",

"iconUrl": "https://www.juhenext.com/wp-content/uploads/2025/10/cropped-Juhenext-200-200.png",

"urls": {

"website": "https://www.juhenext.com",

"getApiKey": "https://www.juhenext.com",

"docs": "https://www.juhenext.com",

"models": "https://www.juhenext.com"

},

"settings": {

"apiHost": "https://api.juheai.top",

"models": [

{

"modelId": "gemini-3-pro-preview-thinking",

"nickname": "gemini-3-pro-preview-thinking",

"type": "chat",

"capabilities": [

"vision",

"reasoning",

"tool_use"

]

},

{

"modelId": "gpt-4.1",

"nickname": "gpt-4.1",

"type": "chat",

"capabilities": [

"vision",

"reasoning",

"tool_use"

]

},

{

"modelId": "text-embedding-3-large",

"nickname": "text-embedding-3-large",

"type": "embedding",

"capabilities": []

},

{

"modelId": "Qwen/Qwen3-Reranker-8B",

"nickname": "Qwen/Qwen3-Reranker-8B",

"type": "rerank",

"capabilities": []

},

{

"modelId": "claude-sonnet-4-5-20250929-thinking",

"nickname": "claude-sonnet-4-5-20250929-thinking",

"type": "chat",

"capabilities": [

"vision",

"reasoning",

"tool_use"

]

}

]

}

}沉浸式翻译

介绍: 全网口碑炸裂的双语对照网页翻译插件。你可以完全免费地使用它来实时翻译外语网页,PDF翻译,EPUB电子书翻译,视频双语字幕翻译等。还可以自由选择调用OpenAI (ChatGPT)、DeepL、Gemini等人工智能引擎来翻译上述内容。在手机上也可以随时随地用哦,真正帮助你打破信息壁垒。

项目地址: https://github.com/immersive-translate/immersive-translate

配置: 安装沉浸式翻译浏览器插件后,在设置中选择OpenAI,并按照图示填写API Key和自定义API接口地址:https://api.juheai.top/v1/chat/completions ,即可开始使用。

![]()

![]()

ChatGPTBox

介绍: 将ChatGPT深度集成到浏览器中, 你所需要的一切均在于此。起初以为这只是一个单纯的浏览器页面翻译插件,直到用起来才发现它不止于此,我觉得它的页面总结和对话的能力更为出色,当然还有更多功能等你发掘。

项目地址: https://github.com/josStorer/chatGPTBox

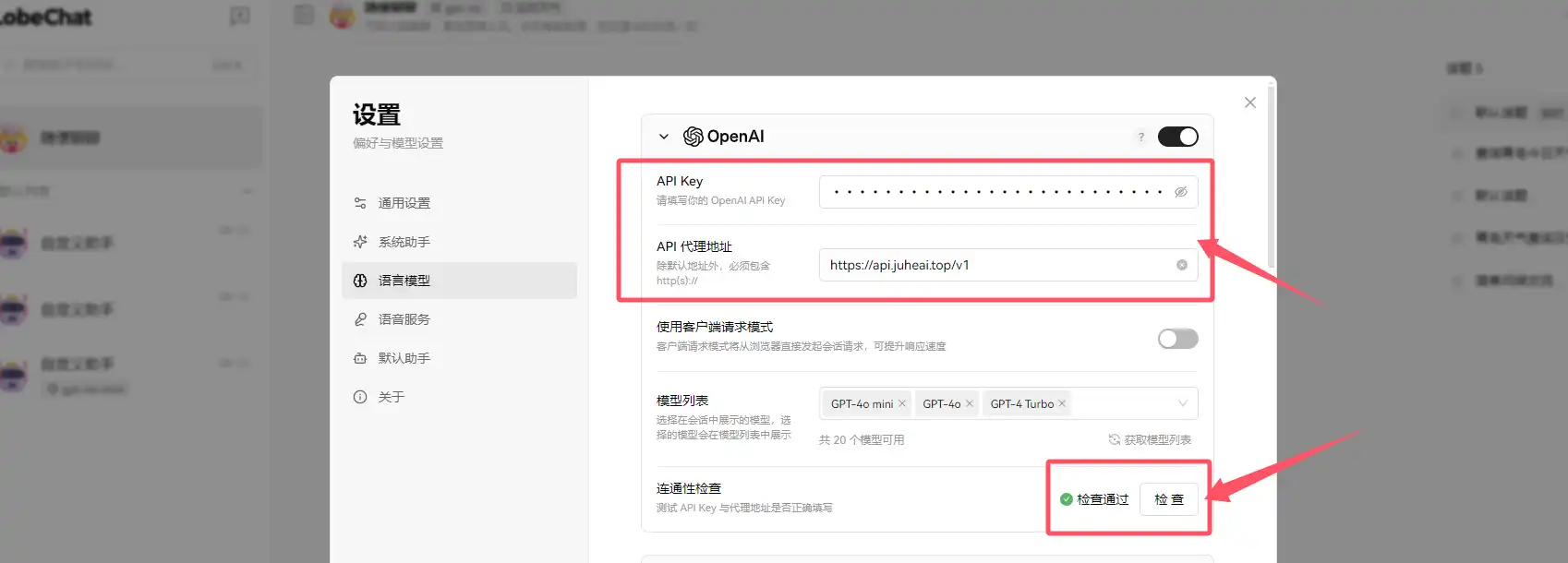

配置: 安装ChatGPTBox插件后,在高级 - API地址菜单中填写自定义OpenAI API地址:https://api.juheai.top ,然后进入常规菜单,在API模式中输入API Key和对应的模型即可使用。

chatgpt-on-wechat

介绍: 基于大模型搭建的聊天机器人,同时支持 微信公众号、企业微信应用、飞书、钉钉 等接入,可选择GPT3.5/GPT-4o/GPT4.0/ Claude/文心一言/讯飞星火/通义千问/ Gemini/GLM-4/Claude/Kimi/LinkAI,能处理文本、语音和图片,访问操作系统和互联网,支持基于自有知识库进行定制企业智能客服。

项目地址: https://github.com/zhayujie/chatgpt-on-wechat

配置方式一: 如果你是docker-compose方式部署,在docker/docker-compose.yml文件中添加如下环境变量:

<!-- 其它参数项 -->

environment:

OPEN_AI_API_KEY: 'sk-xxx'

OPEN_AI_API_BASE: 'https://api.juheai.top/v1'

<!-- 其它参数项 -->配置方式二: 如果直接Python部署,则在config.json文件中添加

<!-- 其它参数项 -->

"open_ai_api_key": "sk-xxx",

"open_ai_api_base": "https://api.openai.com/v1",

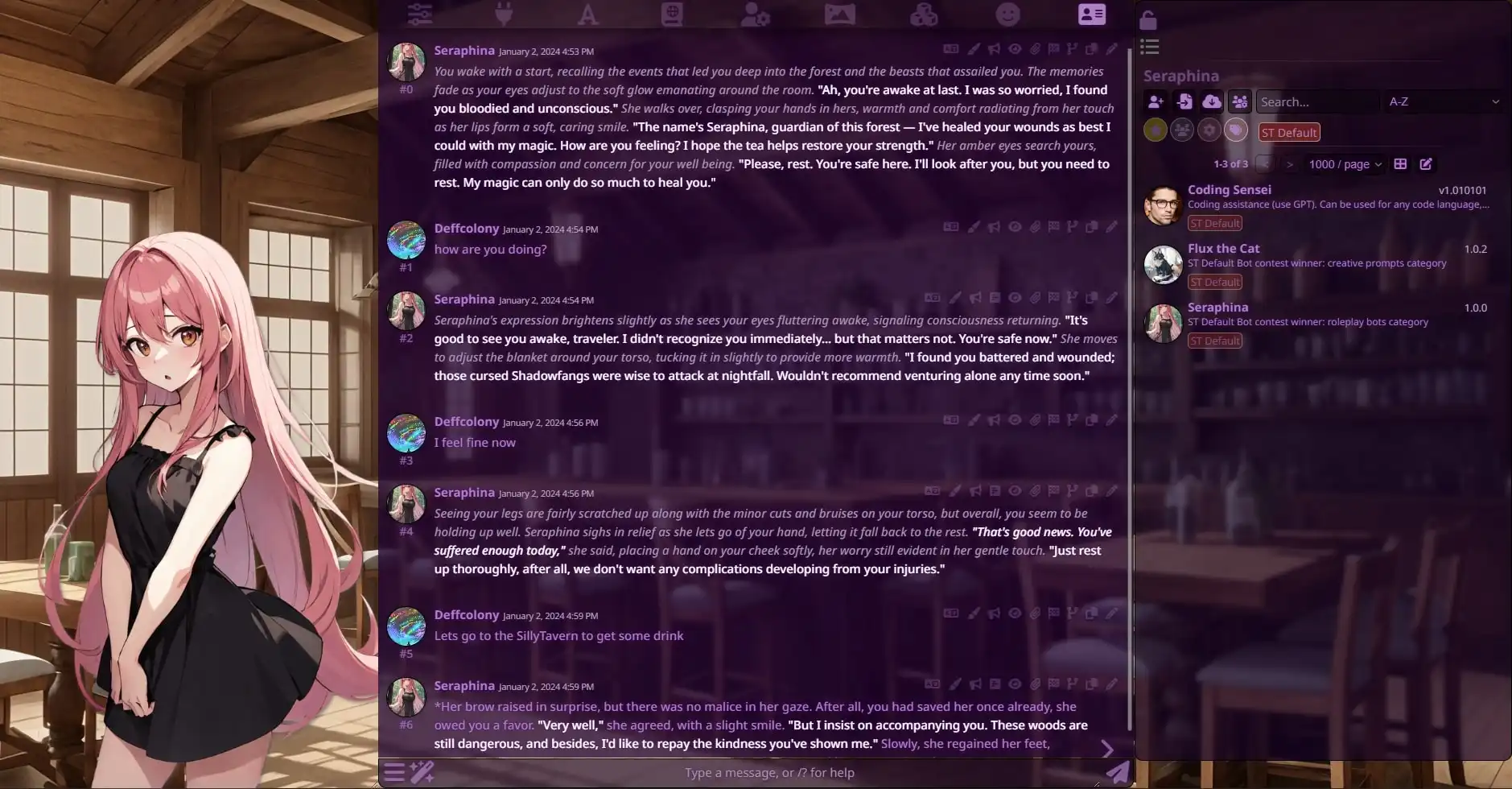

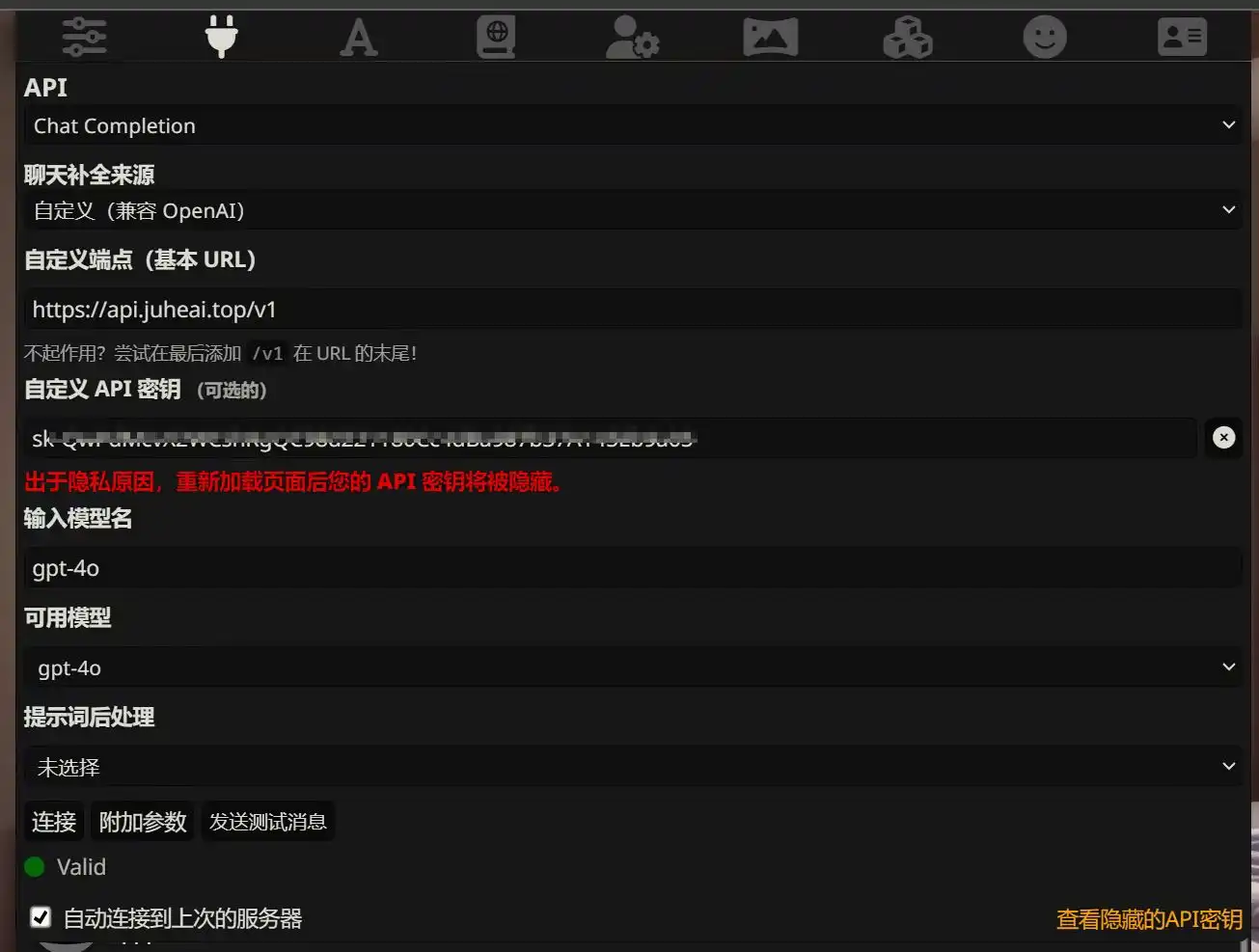

<!-- 其它参数项 -->酒馆SillyTavern

介绍: 看图明意,这是一个可以依托于大模型进行角色扮演的程序,没玩过,感兴趣可以研究研究,JuheNext是完全支持API接入的。

项目地址: https://github.com/SillyTavern/SillyTavern

配置方式: 设置中输入自定义端点:https://api.juheai.top/v1 ,和自定义API密钥。

openai-translator

介绍: 既是浏览器插件也是跨平台桌面端应用,基于 ChatGPT API 的划词翻译浏览器插件和跨平台桌面端应用。

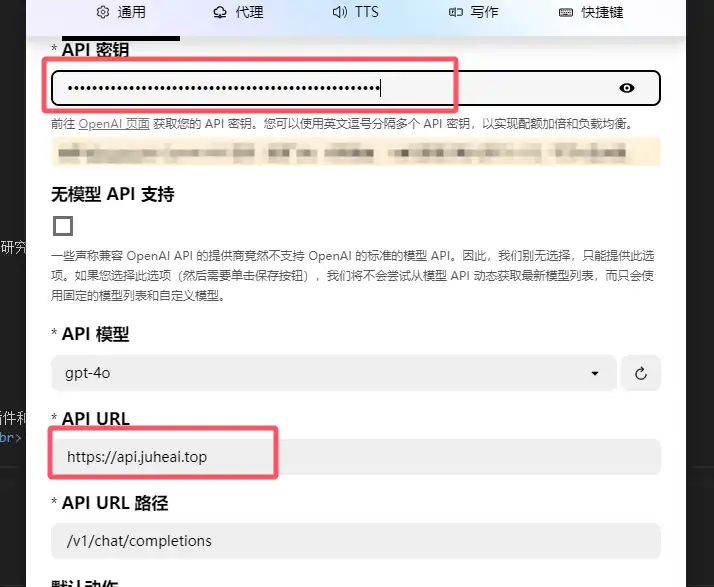

项目地址: https://github.com/openai-translator/openai-translator

配置方式: 设置中输入API URL:https://api.juheai.top 和API密钥。

continue

介绍: continue是领先的开源 AI 代码助手。你可以连接任何模型和任何上下文,在 VS Code 和 JetBrains 里面构建自定义的自动补全和聊天体验。

项目地址: https://github.com/continuedev/continue

配置方式: 安装IDE的continu插件,并在config.json文件中输入如下内容(原自带内容删除):

{

"models": [

{

"title": "JuheAI",

"provider": "openai",

"model": "gpt-4o",

"apiBase": "https://api.juheai.top/v1",

"apiType": "openai",

"apiKey": "sk-xxx"

}

]

}fastgpt

介绍: 基于 LLM 大语言模型的知识库问答系统,提供开箱即用的数据处理、模型调用等能力。同时可以通过 Flow 可视化进行工作流编排,从而实现复杂的问答场景!

项目地址: https://github.com/labring/FastGPT

配置方式: 在对应的文件,Docker Compose部署是在files/docker/docker-compose.yml文件中,部署启动前修改对应的接口和API Key即可。无需部署one-api程序。

<!-- 其它配置 -->

# AI模型的API地址哦。务必加 /v1。这里默认填写了OneApi的访问地址。

- OPENAI_BASE_URL=https://api.juheai.top/v1

# AI模型的API Key。(这里默认填写了OneAPI的快速默认key,测试通后,务必及时修改)

- CHAT_API_KEY=sk-xxx

<!-- 其它配置 -->dify

介绍: Dify 是一个开源的 LLM 应用开发平台。其直观的界面结合了 AI 工作流、RAG 管道、Agent、模型管理、可观测性功能等,让您可以快速从原型到生产。

项目地址: https://github.com/langgenius/dify

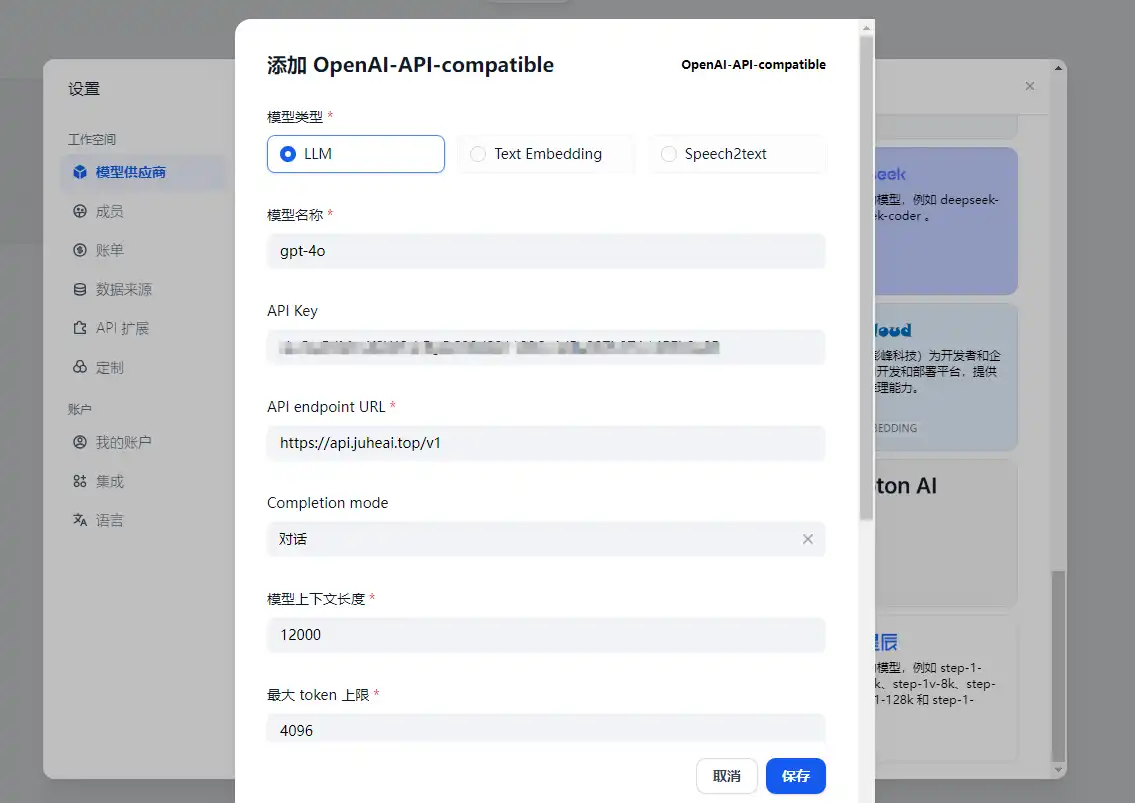

配置方式: 登录程序后,在设置中选择openai-api-compatible,并按照图示设置即可。

gpt_academic

介绍: 为GPT/GLM等LLM大语言模型提供实用化交互接口,特别优化论文阅读/润色/写作体验,模块化设计,支持自定义快捷按钮&函数插件,支持Python和C++等项目剖析&自译解功能,PDF/LaTex论文翻译&总结功能,支持并行问询多种LLM模型,支持chatglm3等本地模型。接入通义千问, deepseekcoder, 讯飞星火, 文心一言, llama2, rwkv, claude2, moss等。

项目地址: https://github.com/binary-husky/gpt_academic

配置方式: 启动程序前,在config.py中修改以下两个环境变量参数:

API_KEY = "sk-xxx"

API_URL_REDIRECT = {"https://api.openai.com/v1/chat/completions": "https://api.juheai.top/v1/chat/completions"}AnythingLLM

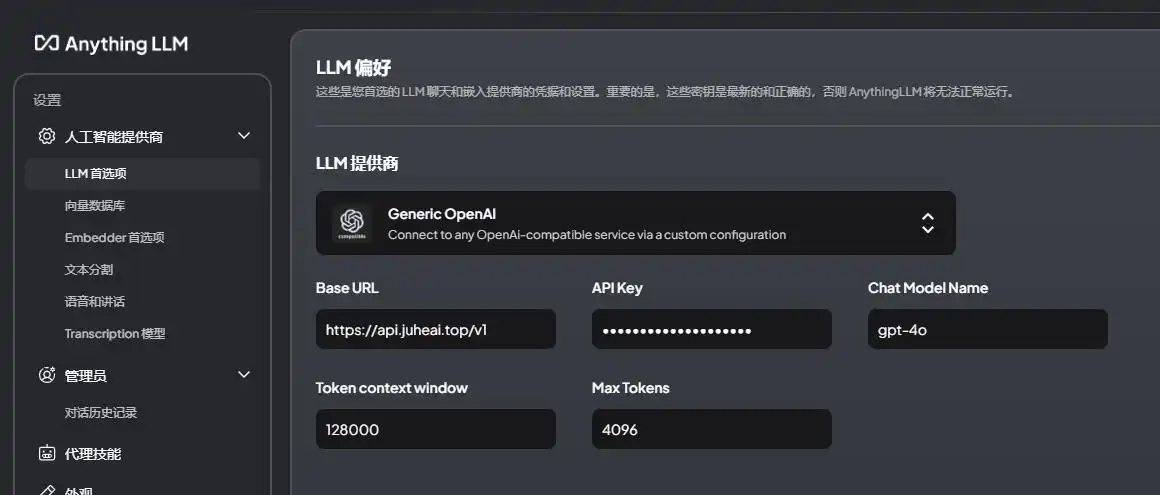

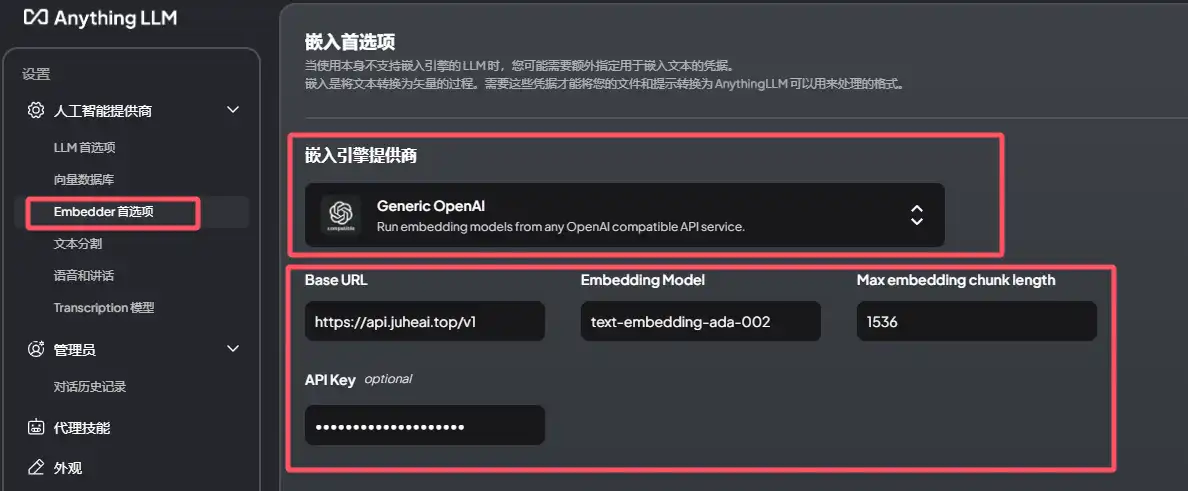

介绍: 您一直在寻找的全方位AI应用程序。与您的文档聊天,使用AI代理,高度可配置,多用户,无需繁琐的设置。

项目地址: https://github.com/Mintplex-Labs/anything-llm

配置方式: 在设置中,可以配置LLM首选项、Embedder首选项,设置LLM提供尚为Generic OpenAI,BaseURL设置为:https://api.juheai.top/v1 ,ChatModelName建议填写:gpt-4o,Embedding Model建议填写:text-embedding-ada-002,Token context window和Max Tokens、Max embedding chunk length按如图数字所示设置即可:

OpenWebUI

介绍: Open WebUI 是一个可扩展、功能丰富且用户友好的自托管 WebUI,设计完全离线运行。它支持各种 LLM 运行器,包括 Ollama 和兼容 OpenAI 的 API。欲了解更多信息,请查阅我们的 Open WebUI 文档。

项目地址: https://github.com/open-webui/open-webui

配置方式: 将环境变量中的OPENAI_API_BASE_URLS替换为https://api.juheai.top/v1即可。

Docker Run

docker run -d -p 3000:8080 \

-v open-webui:/app/backend/data \

-e OPENAI_API_BASE_URLS="https://api.juheai.top/v1" \

-e OPENAI_API_KEYS="sk-xxx" \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:mainDocker Compose

services:

open-webui:

environment:

- 'OPENAI_API_BASE_URLS=https://api.juheai.top/v1'

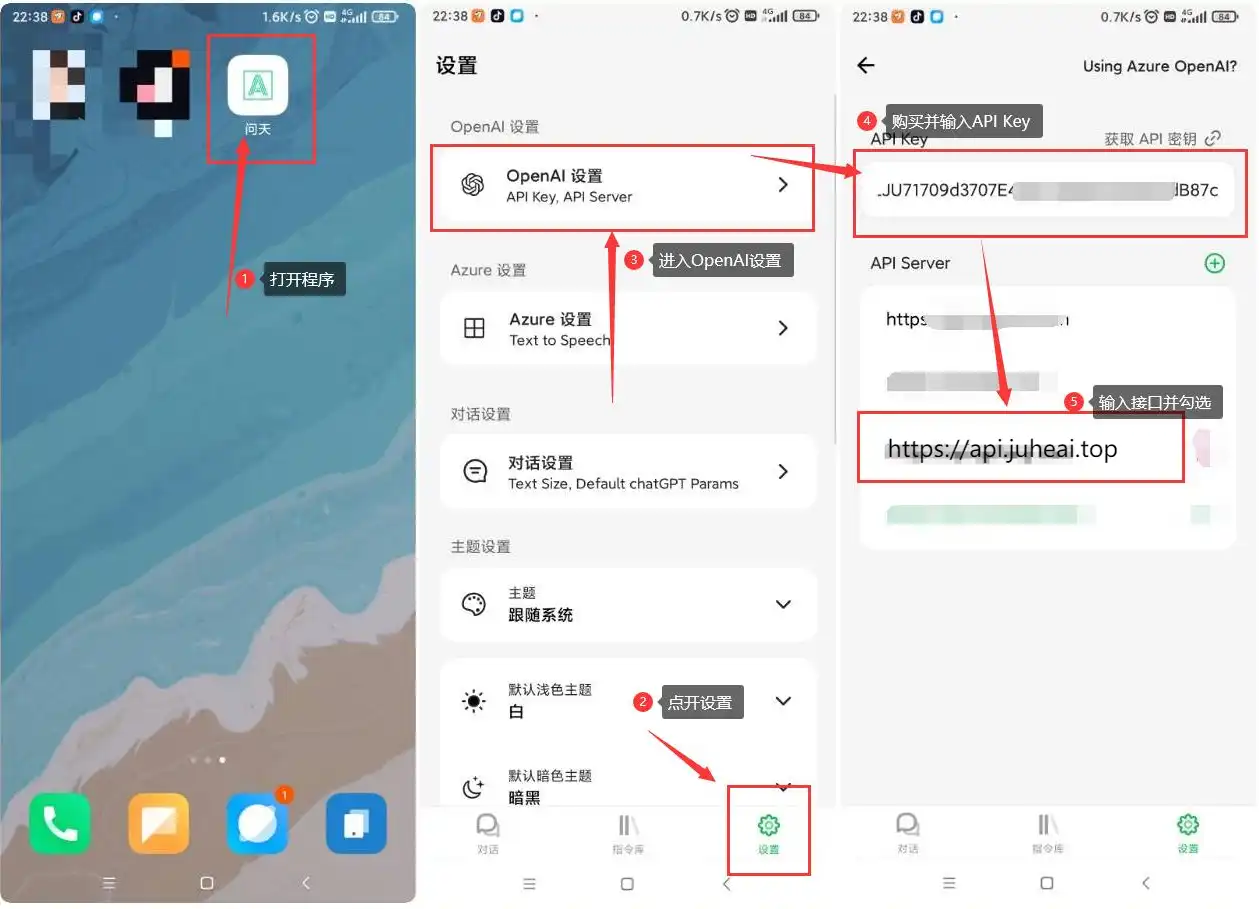

- 'OPENAI_API_KEYS=sk-xxx'BotGem问天

介绍: BotGem是一款智能聊天助手应用,支持PC端和手机端多个系统,使用先进的自然语言处理技术来理解和回应你的文字信息。你可以使用BotGem提问、分享想法、寻求建议或只是随意聊天。

项目地址: https://botgem.com/

配置方式: 打开设置并修改API Server和API Key即可。

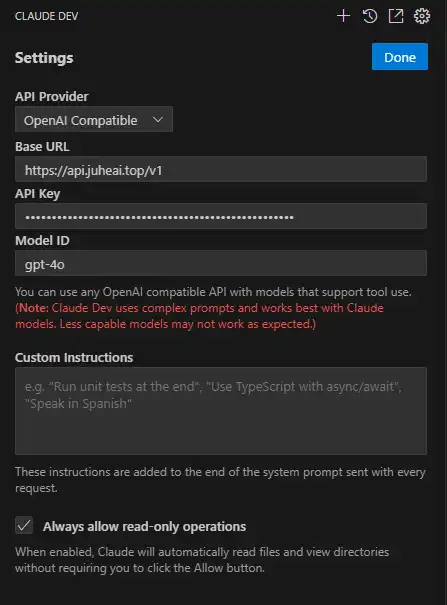

cline

介绍: 在您的集成开发环境(IDE)中,自动编码代理能够在每一步都获得您许可的情况下创建/编辑文件、执行命令等。

项目地址: https://github.com/cline/cline

配置方式: VScode中安装此插件,打开设置并选择OpenAI Compatible,Base URL、API Key、Model ID即可。

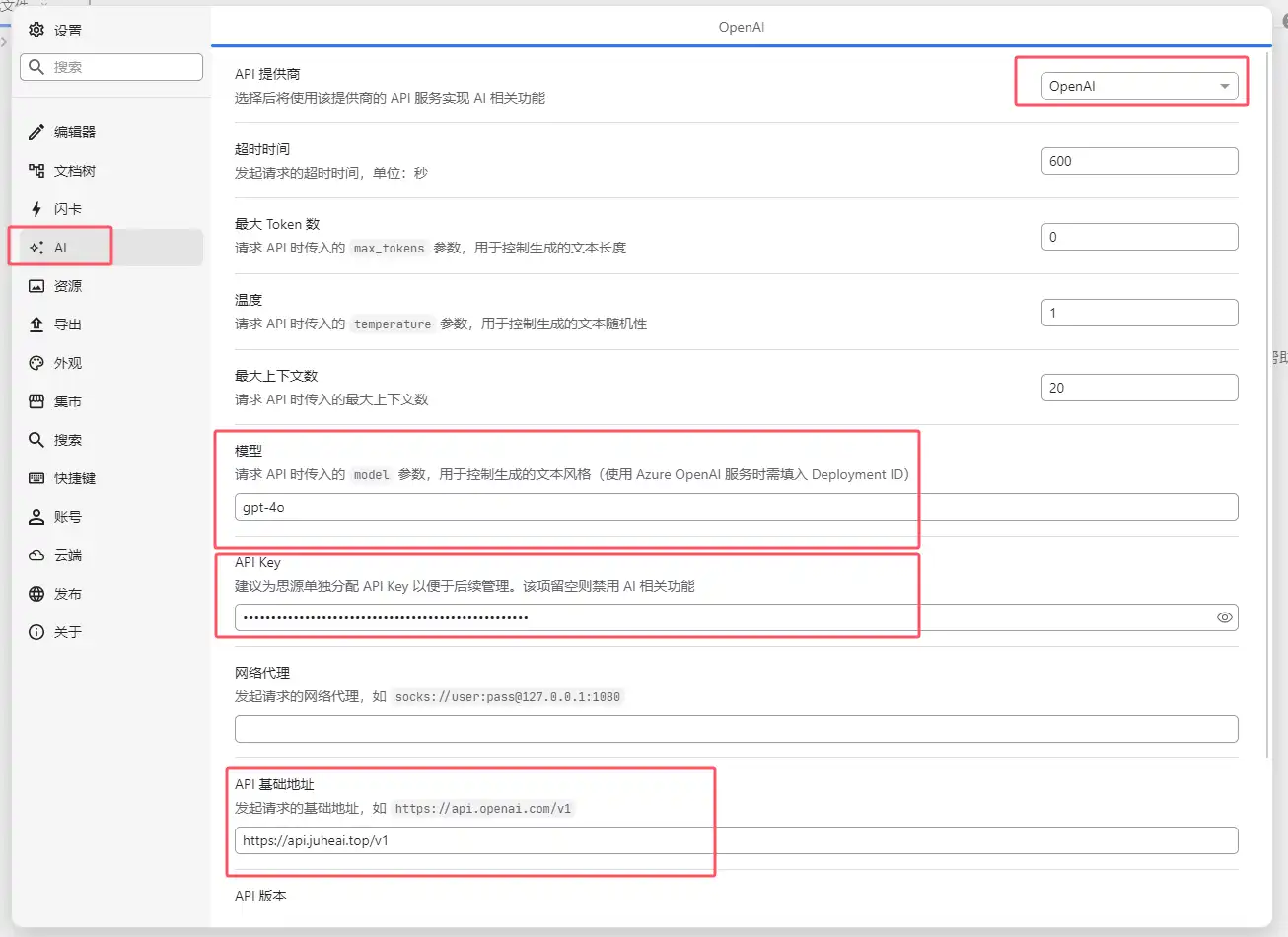

思源笔记

介绍: 思源笔记是一款隐私优先的个人知识管理系统,支持完全离线使用,同时也支持端到端加密同步。融合块、大纲和双向链接,重构你的思维。

配置方式: 在思源笔记设置中,找到AI部分,将模型、API Key、API基础地址三项填写完整,分别填写gpt-4o、你购买的Key:https://api.juheai.top/v1

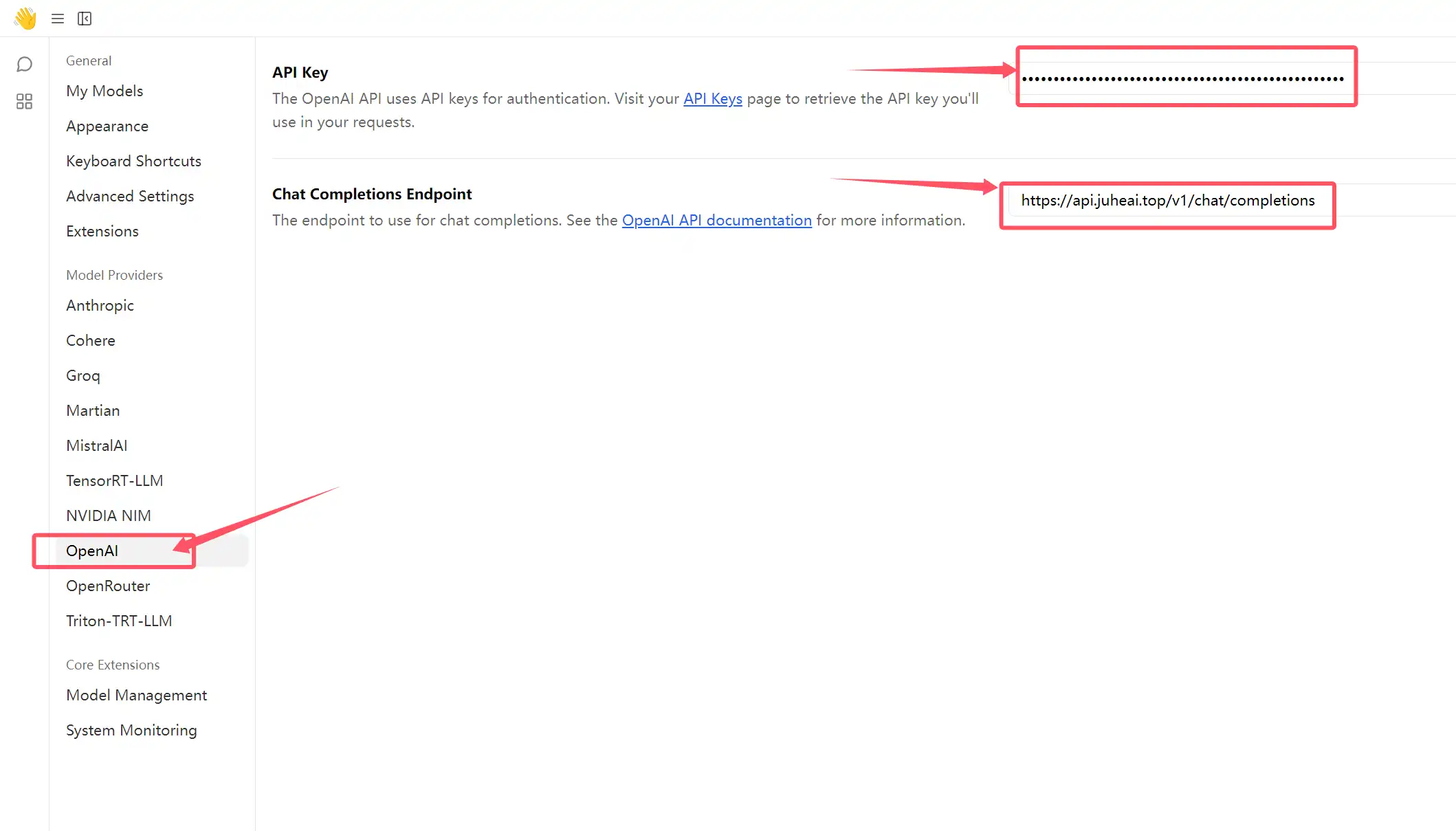

Jan

介绍: Jan 是一种开源的 ChatGPT 替代方案,可在您的计算机上 100% 离线运行。支持多种引擎(llama.cpp、TensorRT-LLM)。

配置方式: 在设置中找到OpenAI,并输入API Key 和接口信息:https://api.juheai.top/v1/chat/completions

如果你有其它需要映射的模型,请联系本站客服。更多模型查询地址:https://api.juheai.top/pricing

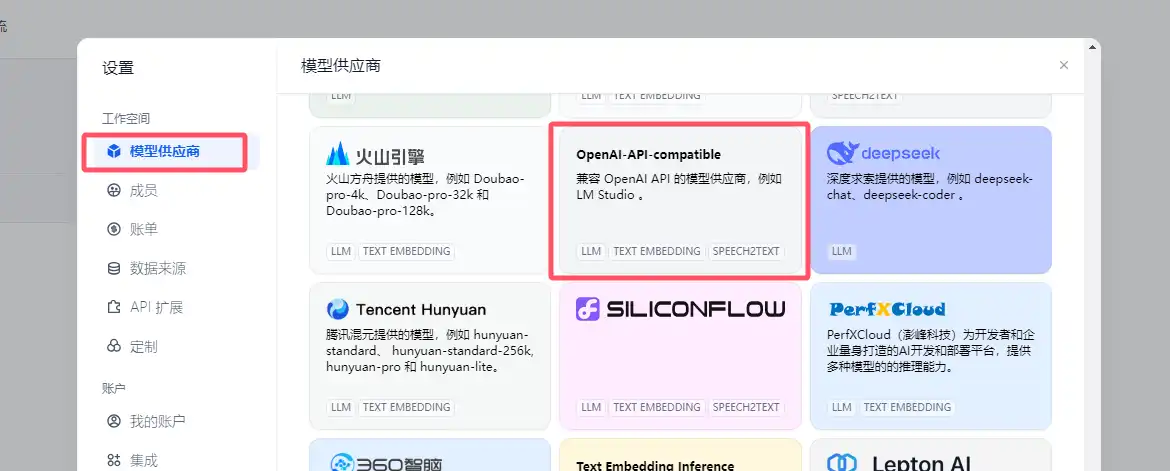

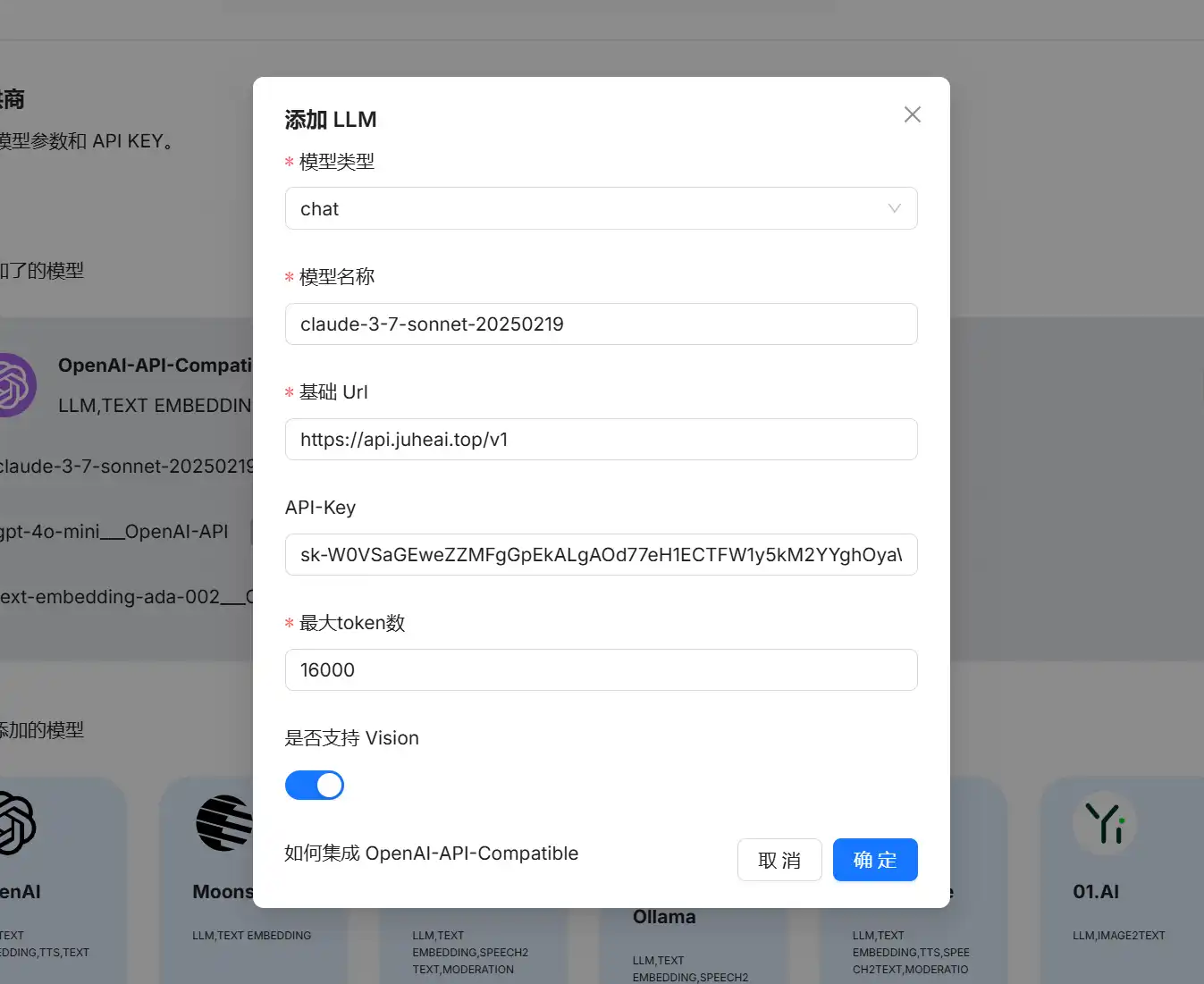

Ragflow

介绍: RAGFlow是一个基于深度文档理解的开源RAG(检索增强生成)引擎,最佳的AI知识库构建工具。

配置方式: 打开Ragflow程序>>,点击右上角的头像,进入模型供应商选项,在待添加模型中选择OpenAI-API-Compatible - 添加模型。

你需要设置四种模型,chat:普通对话模型;embedding:向量模型;rerank:重排模型;image2text:图像转文本模型。首先,可以从此处>>查到所有的模型,然后把目标模型填写ragflow即可。

chat模型的设置(以claude-3-7-sonnet-20250219为例,无论是openai还是claude、gemini,因为JuheNext统一了对接格式,所以都需要通过OpenAI-API-Compatible兼容格式对接):

- 模型类型:

chat - 模型名称:

claude-3-7-sonnet-20250219 - 基础url:

https://api.juheai.top/v1 - API-Key:

sk-xx(填写你自己的key) - 最大tokens数:

16000 - 是否支持Vision:

选中状态(此模型支持视觉识别,勾选后,模型类型会自动添加为imag2text)

embedding模型设置(建议使用text-embedding-ada-002,并发足,效果好)

- 模型类型:

embedding - 模型名称:

text-embedding-ada-002 - 基础url:

https://api.juheai.top/v1 - API-Key:

sk-xx(填写你自己的key) - 最大tokens数:

1500

rerank模型的设置(建议使用bge-reranker-v2-m3)

- 模型类型:

rerank - 模型名称:

bge-reranker-v2-m3 - 基础url:

https://api.juheai.top/v1/rerank - API-Key:

sk-xx(填写你自己的key) - 最大tokens数:

1500

CherryStudio

介绍: 支持多服务商集成的 AI 对话客户端。

配置方式:

OpenAI兼容格式配置

该方式适用于大部分模型,端点为

v1/chat/completions- 进入

设置-模型服务商,点击下方的添加按钮,提供商名称填写JuheNext-兼容,提供商类型选择OpenAI。 - 在

API密钥中填写JuheNext的API-Key,在下方的API地址中填写https://api.juheai.top。 - 进入

管理,选择需要的模型开始对话即可,该模式支持绝大多数模型,包括Gemini、Claude等等,推荐优先使用。

- 进入

OpenAI - Response格式配置

该方式适用于o3、o3-pro等高级模型系列,端点为

v1/responses,注意,通常我们不推荐您使用该模式,仅在o3-pro等高级模型中使用。- 进入

设置-模型服务商,点击下方的添加按钮,提供商名称填写JuheNext-Response,提供商类型选择OpenAI-Response。 - 在

API密钥中填写JuheNext的API-Key,在下方的API地址中填写https://api.juheai.top。 - 进入

管理,选择需要的o3或更高版本系列模型开始对话即可。

- 进入

Gemini格式配置

Gemini模型原生格式,相比于兼容格式,支持更多参数,例如可以开启thinking显示模式等。

- 进入

设置-模型服务商,点击下方的添加按钮,提供商名称填写JuheNext-Gemini,提供商类型选择Gemini。 - 在

API密钥中填写JuheNext的API-Key,在下方的API地址中填写https://api.juheai.top。 - 因为此节点无法正常自动获取模型列表,所以请手动添加,模型查询地址:https://api.juheai.top/pricing。

- 进入

管理,选择需要的Gemini系列模型开始对话即可。

- 进入

Anthropic格式配置

Anthropic模型原生格式,相比于兼容格式,支持更多参数

- 进入

设置-模型服务商,点击下方的添加按钮,提供商名称填写JuheNext-Anthropic,提供商类型选择Anthropic。 - 在

API密钥中填写JuheNext的API-Key,在下方的API地址中填写https://api.juheai.top。 - 同上,因为此节点无法正常自动获取模型列表,所以请手动添加,模型查询地址:https://api.juheai.top/pricing。

- 进入

管理,选择需要的Anthropic - Claude系列模型开始对话即可。

- 进入

Roo Code

介绍: Roo Code 让你在代码编辑器中拥有一整支AI智能体开发团队。

配置方式:

- 选择

设置-API提供商设置为OpenAI Compatible。 OpenAI基础URL设置为https://api.juheai.top/v1,并填入购买的API密钥。- 模型需要自定义填写,如

gemini-2.5-pro。 - 下方勾选

使用传统OpenAI API格式。 - 其余参数按需勾选即可。

- 开始使用。

TIP

开源程序来之不易,希望各位在使用后,去项目地址给作者点点star,我们也会陆续增加更多已支持的开源AI程序,如果您有使用过好的开源AI项目,也欢迎与我们联系进行补充。